陽明交通大學AI學院 雲協技術專家 曾煜棋院長

人類習慣收集資料、累積資料、分析資料,在各種學科裡面都有不少例子。 自從人工智慧日益普及,資料分析已經變成一項新的科學,大學紛紛成立相關科系,而人工智慧的模型就是處理資料、分析資料一個重要的工具。今天利用這個專欄,探討幾個資料運用的技巧,以及相關發展和有趣的資料集。

最常見的型態就是序列型的資料,基本上是有一串的數字或是更高維度的資料串連而成,資料可以依據固定的時間收集,整理而成。例如,每天股市指數、個人生理數據、機器時刻運作情形,經長期串聯累積,則成為序列型的資料。舉一個例子,最近我的研究生下載了美國太空總署(NASA)的SMAP (Soil Moisture Active Passive)衛星資料及MSL (Mars Science Laboratory)的異常偵測資料集,就是序列性的資料,以進行異常偵測模型開發。SMAP由美國雪冰中心(National Snow & Ice Data Center)擁有,由觀測衛星收集所有地球表面土壤水份資料,以幅射量計(radiometer)和L-band雷達收集,自2015年起,週期為2-3天。例如科學家使用該資料進行洪水警告、乾旱預警、農作物採收預測、氣候預測等相關應用。MSL由Curiosity火星任務探測車自2012年收集火星表面資料,含影像和非影像型態。

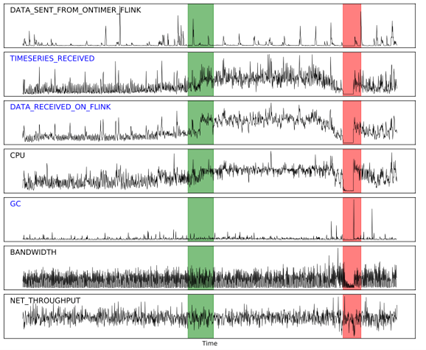

異常偵測通常標注很少,甚至沒有標注,而且異常的比例很低。研究人員通常運用資料重建(reconstruction)或是資料預測(forecasting)的方式來進行異常偵測;前者是讓模型看過大量資料,而且試著把輸入重建,如果重建的資料與原始資料差異過大,表示該筆資料異常的機會很高;後者則是讓模型閱讀大量資料,並預測下一筆未來的資料,如果預測的資料與真實發生的資料差異過大,表示當時發生異常的機會很高。通常偵測率要達到99%以上,在實務上才具有價值,當然背後支撐的,就是重建或預測的深度學習模型要有足夠的準確率。圖一為有多個特徵的序列型的資料,在一段序列型的資料中,會有些時刻的資料為異常的(如紅色匡內所示),其餘時刻為正常的資料(如綠色匡內所示),透過學習未標注的序列型資料(如白色匡內所示)的特徵,來達到自動判斷正異常和回報異常狀況的發生。

圖一:序列型的資料以及異常偵測 [1]

第二種常見的型態就是影像,包含自然影像、醫學影像、熱影像等等,這也是近年人工智慧突破發展最快的一部分。常見的自然影像應用包含交通路況及無人商店攝影監視,醫學影像包括各種器官與疾病的自動辨識偵測,而熱影像可以在較具隱私前題下收集溫度反應,高光譜影像可以判斷水果的甜度以及一些肉眼無法看到的資訊。影像的標注工作如果使用人力則很耗時,能夠自動化的話則可以節省許多時間。

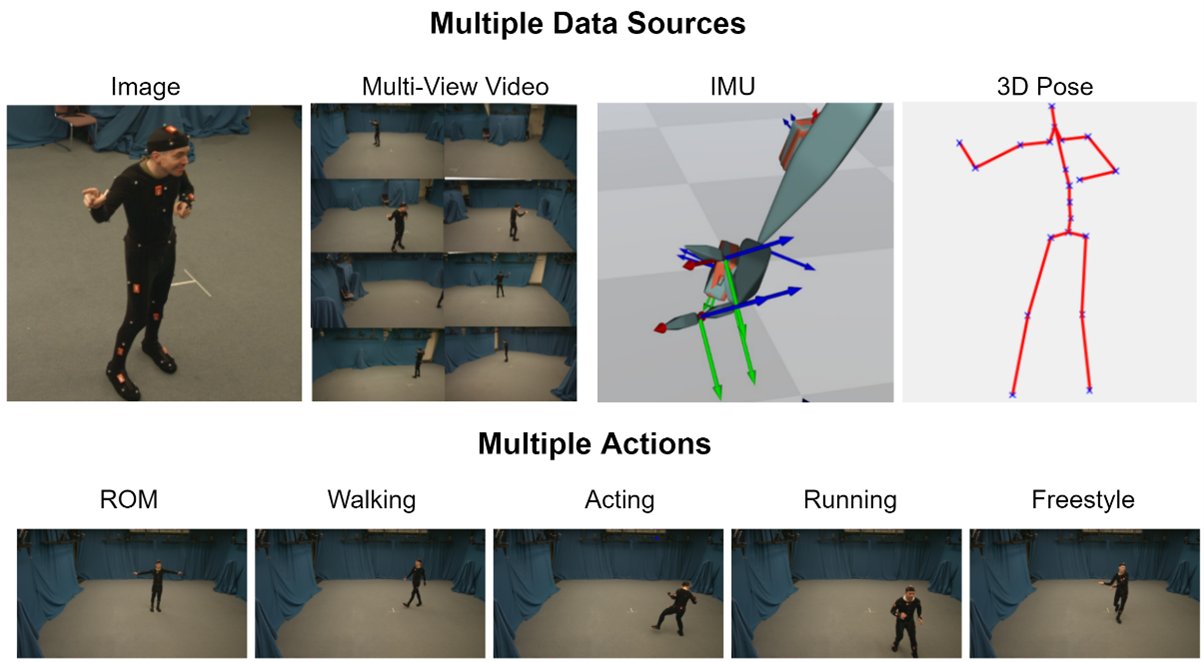

例如,Human3.6M就是一個大型的影像資料集,包括360萬張以上人物影像及其姿態的標注,包含的動作有打電話、拍照、打招呼、飲食…等。這個資料集對於發展人體骨架分析的研究人員有莫大的幫助,相關姿態分析的模型不斷推陳出新,也可以進一步研究活動辨識(activity recognition)的題目,這個精準的資料集使得相關的研究快速進展。活動辨識的方法更是不斷翻新,近期研究人員發現使用圖形卷積 (graph convolutional)運算,對活動辨識分析更具精準判斷能力;常見的方法是在時序上進行分析,新的研究也發現由時域轉為頻率域計算,類似傅立葉轉換,也有新的突破。 例如,近期我的研究生為了研究感測器以及影像中人物姿態的相關性,需要大量的相關資料,以證明模型的可靠度。為了達到這個目標,下載了TotalCapture資料集,這個資料集裡面對於影像中的人物,提供多個攝影機的視角,同時也在人體身上中放置了高達13個慣性感測器(IMU),並且使用vicon系統進行精準的3D人體骨架標記,其中的動作內容也十分豐富,包含步行、表演、體操瑜伽、自由動作等。這個研究主題也充分呈現影像資料與感測器資料庫的應用,因為影像是以相素及顏色組成,經常有遮蔽的問題,而慣性感測元件數值則是透過無線通訊傳輸的3度空間運動資料,穿戴於人體可以克服這些視覺上的障礙。

圖二:TotalCapture資料集以及骨架偵測 [2]

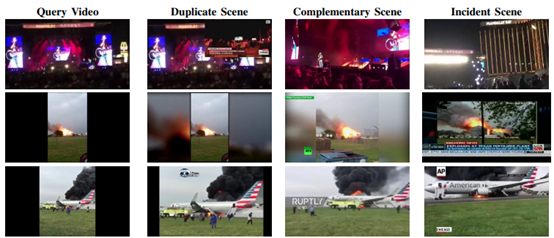

第三種常見的資料型態是視訊資料,它是連續影像,由於手機以及監視設備日益普及,視訊資料幾乎隨手可得。最常見的資料來源就是YouTube 等相關社交媒體上面刊登的影片。當然這些影片在作為研究用途時,有隱私及版權疑慮,必須先行克服。舉例而言,我的研究生近期探索一個新的視覺搜尋(video retrieval)任務,可輸入一段影片,並且在資料庫裡面找出內容的相似的影片;例如同樣一個社會事件,經由不同的記者拍攝,場景雖然相同,但是所拍攝的角度、長短、重點都可能不盡相同。視覺搜尋任務成為新的挑戰,可分類為NDVR (near-duplicate video retrieval)、FIVR (fine-grained incident video retrieval)、EVR (event video retrieval)、AVR (action video retrieval)四種不同的任務,相關的資料集包含CC_WEB_VIDEO、FIVR-200K、EVVE,例如FIVR-200K就有22萬支視訊,提供模型訊練。FIVR-200K的影片取自YouTube上Armed conflicts and attacks及Disasters and accidents兩種種類的新聞事件,並將影片搜尋任務分為以下三類:(1) Duplicate Scene Videos (DSV) 任務:和查詢影片至少有一個重複地場景;(2) Complementary Scene Videos (CSV) 任務:含有部分時空重疊片段,但取自不同的視角;(3) Incident Scene Videos (ISV) 任務:和查詢影片為相同事件,但時空並不重疊。有了這些資料集,相關的研究自然就蓬勃發展,研究人員提出不同的卷積運算以及自動編碼器,抽取視訊資訊特徵資訊;或是運用多重空間解析度分析,了解影片中的深度內容及前後時間空間關聯性。

圖三:FIVR資料集以及視覺搜尋(video retrieval)任務 [3]

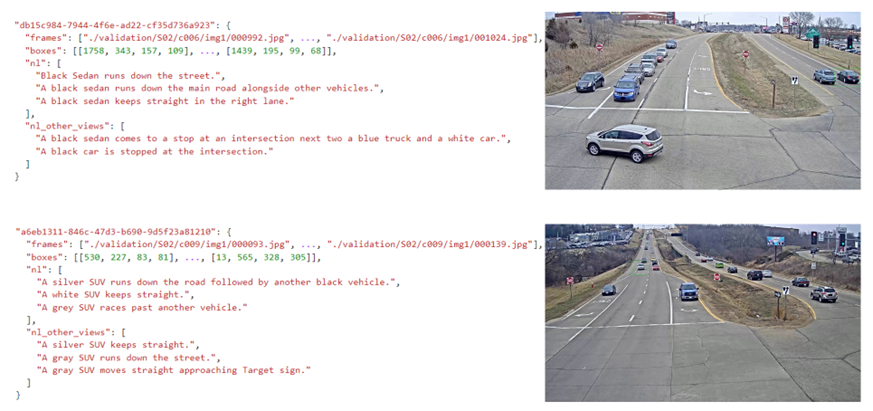

第四種常見的資料型態是文字,甚至以自然語言文句呈現。一個例子是國際的AI City Challenge,這個挑戰賽是希望運用人工智慧技術解決智慧城巿的各項問題,提昇城巿運行的效率,例如改善交通、強化交通安全、增加能源效率、加速結帳速度等。這個比賽的主軸是結合城市裡面的監視錄影設備,用自然語言的方式進行影片搜尋、駕駛資料、異常偵測等題目,核心技術則是視覺圖像辨識。2022年的挑戰賽有以下的題目:城市裡面多個攝影機之車輛追蹤、自然語言搜尋路上車輛、駕駛行為辨識、商品辨識計算及自動結帳。其中第二項自然語言搜尋路上車輛的題目,資料集裡面提供一段影片,並且標注達三句自然語言描述,以及一至多項不等的環境相關的文句描述,目的是使用自然語言描述,就可以在視訊資料庫裡面找到相關的影片片段。對於車輛的描述,包含車輛大小、型態、顏色、車輛移動情形、與其他車輛的關係、與環境之間的關係等。可以想像,在這些影片裡面加入自然語言的人工標注是一件辛苦的人力工作,整個資料及大約有1000多筆視訊影片,算是得來不易,圖四即為範例。當然在模型的開發部分,研究人員也用盡各種技術,有興趣的讀者可以參考相關論文。

圖四:AI City Challenge挑戰賽車輛搜尋資料集範例 [4]

依據以上的介紹,可以了解資料的累積,也可以推動人工智慧快速發展,資料本身的處理以及分析技術,儼然已經成為一項重要的科學研究項目。除了以上談到的幾個資料集,有些研究人員更有突破性的想法,當資料不夠多或是 欠缺某一類型資料時,就開發一些模型及工具,讓模型幫我們產出想要的模擬資料。常見的範例如自駕車、無人機AirSim模擬軟體,在模擬軟體或是遊戲情境裡面獲取相關的資料。甚至也有研究人員運用生成對抗網路(GAN),產出各種想像中的資料。這些資料多數以影像的方式呈現,例如IC電路板瑕疵、金屬表面磨損瑕疵等相關的照片,這些模擬的照片,同樣也是用來訓練深度學習的模型。在資料的收集方面可以從網際網路,或是許多GitHub獲得。光是尋找各種資料來源,就是一件有趣的事,未來有機會再向讀者介紹更多的資料範例。

參考資料:

- H. Zhao et al., “Multivariate timeseries anomaly detection via graph attention network,”in IEEE International Conference on Data Mining, 2020.

- Total Capture: 3D Human Pose Estimation Fusing Video and Inertial Sensors, M. Trumble, A. Gilbert, C. Malleson, A. Hilton , J. Collomosse. In BMVC 2017

- G. Kordopatis-Zilos, S. Papadopoulos, I. Patras and I. Kompatsiaris, "FIVR: Fine-Grained Incident Video Retrieval," in IEEE Transactions on Multimedia, vol. 21, no. 10, pp. 2638-2652, Oct. 2019.

- AI City Challenge, 2022, https://www.aicitychallenge.org